核心建议:GLM-5.1在SWE-bench Pro基准以58.4分超越GPT-5.4和Claude Opus 4.6,三大代码评测综合平均分位列全球第三、开源模型第一。该模型支持8小时长程自主任务,在向量数据库优化场景中实现6倍吞吐量提升。采用MIT协议完全开源,支持商业使用,适合需要长周期自动化工程任务的开发团队评估,但需注意754B参数规模对硬件的高要求。

一、架构与核心参数

GLM-5.1采用754B参数Mixture-of-Experts(MoE)架构,单次推理激活40B参数,配备200K Token上下文窗口与131K Token最大输出长度 。其核心技术突破在于DeepSeek Sparse Attention(DSA)稀疏注意力机制,通过仅关注关键信息片段降低长文本处理算力消耗,同时保持上下文理解能力 。

值得注意的是,该模型完全基于华为昇腾910B芯片训练,未使用英伟达硬件,验证了中国本土算力基础设施训练前沿模型的可行性 。

二、代码能力评测对比

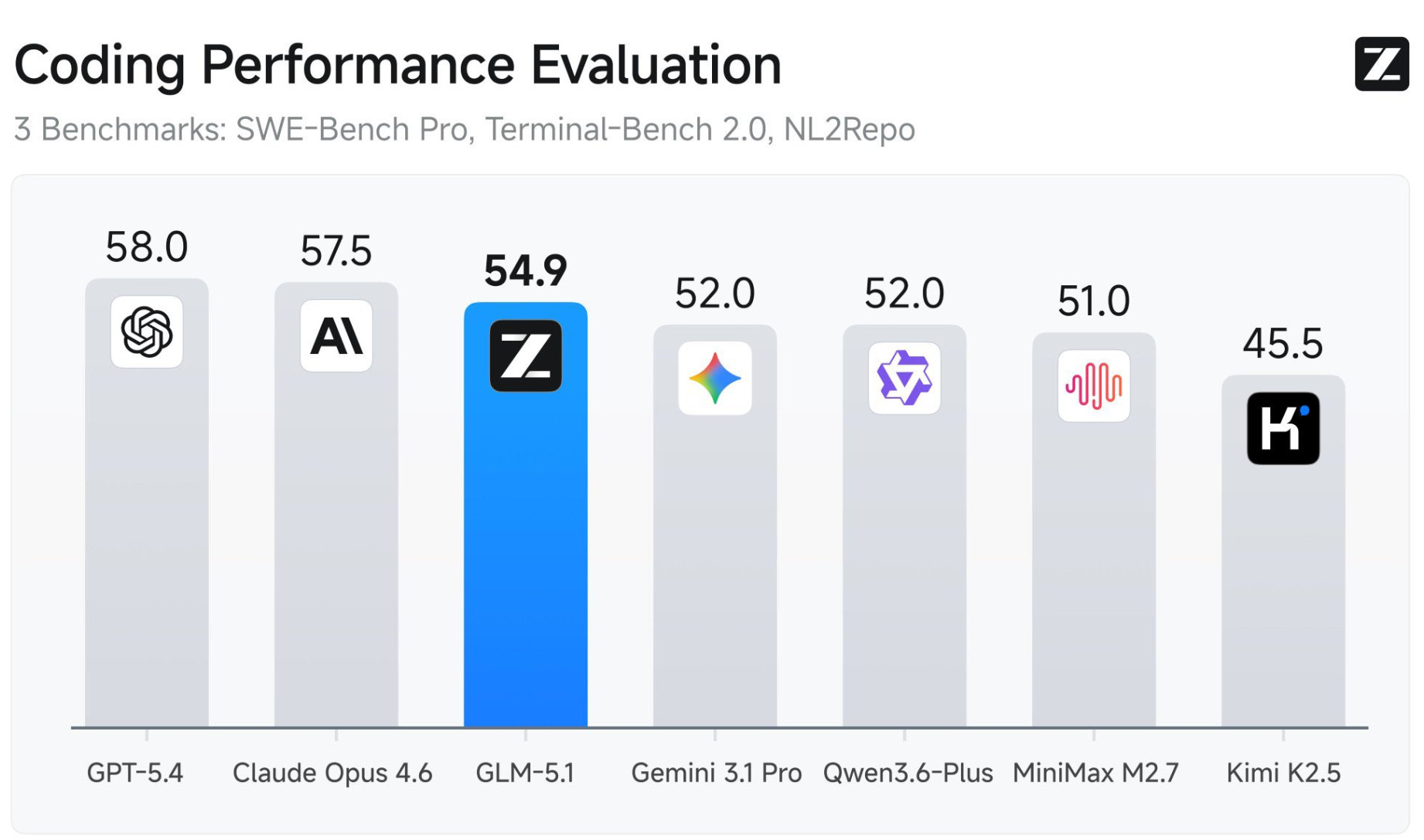

在代表真实软件开发能力的权威评测中,GLM-5.1表现如下:

| 评测基准 | GLM-5.1 | GPT-5.4 | Claude Opus 4.6 | Gemini 3.1 Pro | 排名说明 |

|---|---|---|---|---|---|

| SWE-bench Pro | 58.4 | 57.7 | 57.3 | 54.2 | 该基准第一 |

| Terminal-Bench 2.0 | 待验证 | 待验证 | 领先 | 待验证 | 命令行任务 |

| NL2Repo | 待验证 | 待验证 | 领先 | 待验证 | 代码库生成 |

| CyberGym | 68.7 | 待验证 | 66.6 | 待验证 | 网络安全 |

| KernelBench Level 3 | 3.6倍加速 | 待验证 | 4.2倍加速 | 待验证 | GPU内核优化 |

综合定位:在SWE-bench Pro、Terminal-Bench 2.0、NL2Repo三大代码基准的综合平均分中,GLM-5.1取得全球第三、国产模型第一、开源模型第一的成绩 。在SWE-bench Pro单项上,以58.4分成为该基准目前公开记录中的高分模型 。

三、长程任务与Agent能力

GLM-5.1的核心差异化能力在于长周期自主任务执行(Long-Horizon Task),区别于传统分钟级交互模型:

8小时持续工作验证:模型可在单次任务中独立运行超过8小时,期间自主完成规划、执行、测试、错误修复与策略调整,最终交付工程级成果。在内部测试中,模型用8小时、1200余步操作从零构建出包含文件管理器、终端、文本编辑器的完整Linux桌面Web应用,相当于4人团队一周工作量 。

向量数据库优化:通过655轮迭代与6000余次工具调用,将向量检索查询吞吐量从基线3,547 QPS提升至21,500 QPS,实现约6倍性能提升,期间自主完成6次架构级重构 。

自我进化机制:当现有策略进入平台期时,模型能主动分析日志并切换至结构性不同的方案,形成"实验→分析→优化"闭环,而非等待人工干预 。

四、本地部署步骤

对于希望私有化部署的开发者,建议按以下流程操作:

硬件评估:确认具备企业级GPU集群资源。754B参数规模(激活40B)对显存与算力要求较高,消费级硬件难以承载完整模型推理 。

获取模型权重:访问Hugging Face仓库(

zai-org/GLM-5.1)或ModelScope(ZhipuAI/GLM-5.1)下载标准版或FP8量化版权重文件 。环境配置:使用vLLM或SGLang推理框架进行部署。华为云用户可通过ModelArts平台一键完成推理服务部署,支持公共池与专属池两种资源模式 。

工具链集成:在Claude Code、OpenCode、Kilo Code等主流开发工具中,通过修改配置文件将默认模型指向GLM-5.1 API端点,实现开发环境无缝切换 。

API调用:通过BigModel开放平台(

bigmodel.cn)或Z.ai(z.ai)获取API密钥,输入成本约$1.40/百万Token,输出成本$4.40/百万Token,缓存命中Token成本$0.26/百万Token 。

五、开源协议与商业使用

GLM-5.1采用MIT许可证完全开源,这是中国头部大模型厂商首次以如此宽松的条件开源旗舰级模型 。MIT协议允许用户自由使用、修改、分发及商业部署,无需支付授权费用或公开衍生作品源码。

需注意的是,智谱同步上调了API服务价格10%,调价后Coding场景缓存命中Token价格已接近Anthropic Claude Sonnet 4.6水平,标志着国产大模型首次在核心场景实现与海外头部厂商的价格对齐 。

六、适用场景与局限

建议使用场景:

长周期工程任务:需要数小时连续执行且需多次策略调整的软件工程任务,如系统架构优化、复杂Bug修复。

向量数据库调优:涉及多轮迭代与参数调优的数据库性能优化工作。

自动化代码仓库构建:从需求描述直接生成完整可运行的项目代码库(NL2Repo场景)。

当前局限:

硬件门槛:754B参数规模需要专业级算力支持,不适合个人开发者本地运行 。

复杂逻辑推理:在Humanity's Last Exam等抽象推理评测中得分31.0(工具辅助下52.3),与顶尖闭源模型仍有差距 。

长上下文一致性:在跨越数千次工具调用的执行轨迹上保持一致性仍面临挑战 。

总结:GLM-5.1的开源标志着国内大模型在工程化能力上的重要突破,其8小时长程任务能力与MIT开源协议为开发者提供了新的技术选项。建议有长周期自动化需求的工程团队优先评估,但需充分评估硬件投入成本与模型在特定业务场景中的实际表现。