使用AI代码模型时,建议优先建立清晰的项目上下文配置文件(如CLAUDE.md),采用分阶段验证的工作流程,并避免在单次会话中处理过多任务类型。这些基础原则能显著降低模型输出偏差,提升协作效率。

一、为什么需要关注代码模型使用规范

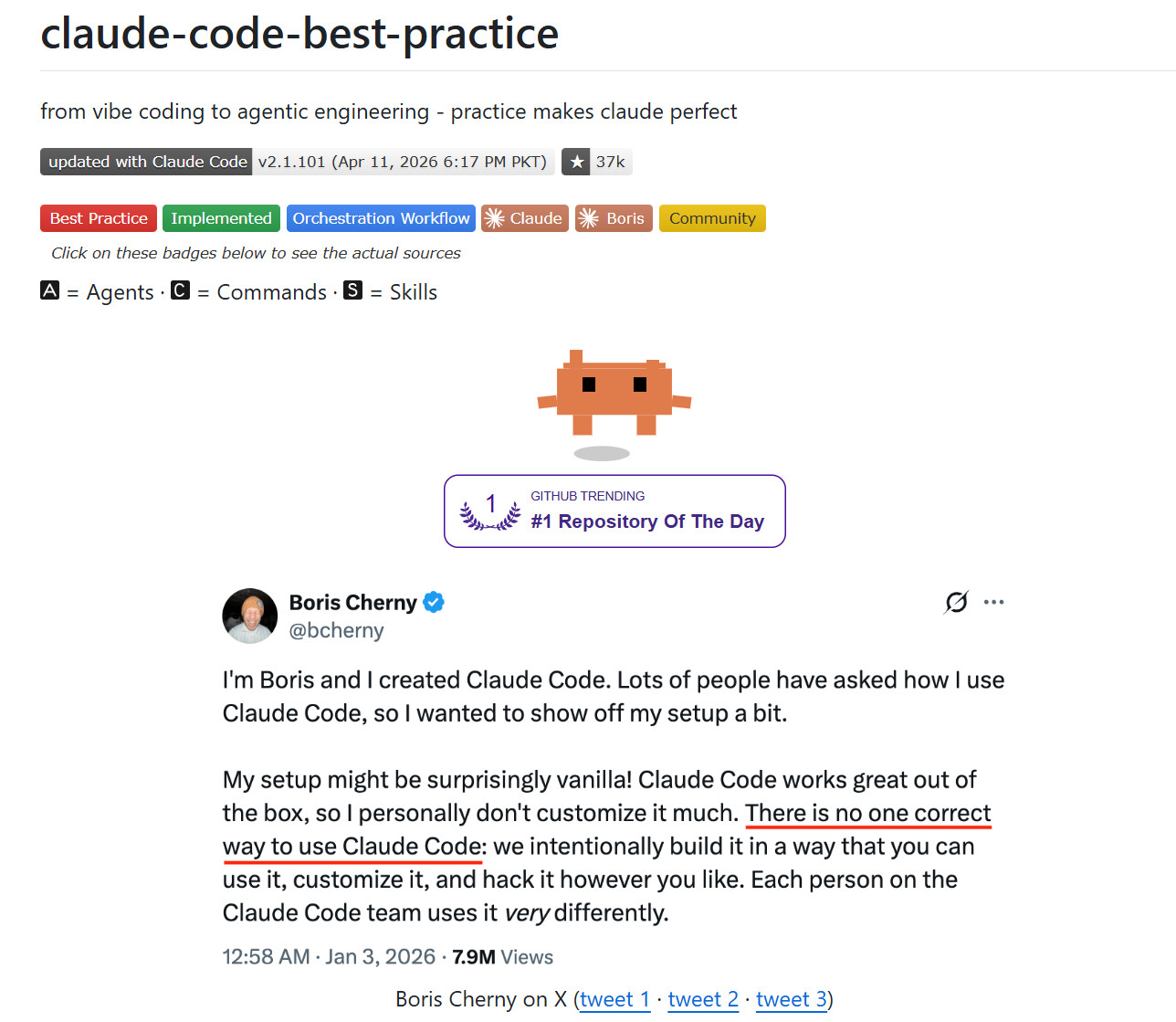

随着AI辅助编程工具的普及,开发者面临的新挑战不再是"能否生成代码",而是"如何让模型输出符合工程标准"。社区维护的 claude-code-best-practice 仓库系统整理了从基础配置到高级工作流的实践方法,目前已成为众多开发者参考的技术资源 [[1]]。

该仓库强调从"灵感式编码"(vibe coding)向"代理式工程"(agentic engineering)的思维转变,核心在于建立可复用、可验证、可协作的开发范式 [[2]]。

二、关键配置:让模型理解你的项目

2.1 CLAUDE.md 的作用与编写要点

CLAUDE.md 是项目级的上下文配置文件,可自动注入对话上下文,帮助模型快速理解项目结构、编码规范与构建流程 [[28]]。

编写建议:

单个文件建议控制在200行以内,避免信息过载导致模型忽略关键指令

使用

<important if="...">标签包裹领域特定规则,提升指令优先级在单体仓库中采用多级

CLAUDE.md文件,实现祖先-后代加载机制将构建、测试、部署等核心命令明确列出,确保"新人+模型"能一键运行项目

2.2 权限与沙箱配置

合理的权限设置既能保障安全,又不影响开发效率:

| 配置方式 | 适用场景 | 注意事项 |

|---|---|---|

| 手动确认模式 | 初次使用或高风险操作 | 需人工审核每条命令,效率较低 |

| 通配符权限 | 重复性任务(如 Bash(npm run *)) | 需精确限定路径与命令范围 |

| 沙箱隔离 | 文件编辑与网络访问分离 | 可减少约84%的权限确认提示 [[2]] |

三、工作流设计:从规划到交付的闭环

3.1 推荐的分阶段执行流程

需求澄清阶段:使用

/plan模式让模型输出结构化方案,明确输入、输出与验收标准小步验证阶段:将大任务拆分为可独立测试的子任务,每完成一步即运行验证

上下文管理阶段:当会话上下文占用超过50%时,主动使用

/compact或/clear重置状态代码审查阶段:启用

/code-review或多模型交叉验证,识别潜在逻辑漏洞归档与迭代阶段:使用 Git 频繁提交,每完成一个功能点即创建清晰提交的记录

3.2 常见误区对比

| 误区表现 | 潜在风险 | 改进建议 |

|---|---|---|

| 单次会话处理多类型任务(修Bug+写新功能+写文档) | 上下文污染,模型注意力分散 | 按任务类型拆分独立会话,使用 /rename 标注会话目的 |

| 过度依赖模型自动修复 | 可能引入隐蔽逻辑错误 | 要求模型输出变更说明,并配合自动化测试验证 |

| 忽略项目历史上下文 | 生成代码与现有架构风格不一致 | 在 CLAUDE.md 中明确编码规范,或提供典型代码示例 |

| 未设置回退机制 | 错误修改难以追溯 | 启用 Git 自动检查点,熟悉 /rewind 等回退命令 |

四、进阶技巧:提升协作质量的实用方法

4.1 子代理与技能的合理使用

子代理(Subagents):适合需要独立上下文的专项任务,如代码审查、测试生成。建议为不同功能配置专属代理,避免通用型代理导致指令模糊 [[2]]。

技能(Skills):将高频操作封装为可复用技能,如

/simplify用于代码简化、/techdebt用于技术债分析。技能描述应聚焦"触发条件"而非功能摘要,帮助模型准确判断使用时机。

4.2 上下文工程的核心原则

精简优先:只注入当前任务必需的上下文信息,避免全量代码库导入

动态更新:定期审查

CLAUDE.md与技能文件,移除已失效的指令分层管理:全局配置(

~/.claude/)、项目配置(根目录)、模块配置(子目录)三级联动验证闭环:任何配置变更后,通过"运行测试"等标准操作验证模型理解是否准确

五、持续优化:建立个人与团队的实践库

建议将验证有效的配置、技能与工作流纳入团队知识库,并建立定期回顾机制。社区实践表明,当开发者能将重复操作转化为标准化命令或技能时,日常开发效率可获得可观提升 [[34]]。

同时,关注官方更新与社区分享,及时吸收经过验证的新模式。例如,近期推出的 /ultraplan 云端规划、/schedule 定时任务等功能,为长周期任务管理提供了新可能 [[2]]。

小结:使用代码模型的核心不在于追求"一键生成",而在于构建"人机协同"的可持续工作流。通过规范配置、分步验证与持续迭代,开发者可以将模型能力稳定转化为工程产出。

本文内容基于公开技术社区资源整理,旨在提供客观参考。实际使用时请结合项目特点灵活调整,并遵守相关开源协议与企业规范。