核心结论:开源编程模型的成本效率革命

你的编程Agent账单正在吞噬预算。 当Claude Opus 4.6单次复杂任务调用成本超过4美元时,MiniMax M2.7以仅为其1/17的输入价格、1/21的输出价格,在SWE-Bench Verified基准上实现了78%的准确率——与Opus 4.6的80.84%仅相差不到3个百分点。

2025年4月,MiniMax正式将M2.7模型权重开源至Hugging Face平台。这不仅是代码能力的释放,更是生产级AI Agent部署成本的结构性重构。

技术架构:为什么10B参数能挑战旗舰模型

MoE架构的效率突破

MiniMax M2.7采用Mixture-of-Experts(混合专家)架构,每token仅激活10B参数,却通过自我进化训练机制实现了与全参数模型相媲美的性能。

自我进化的核心逻辑:

失败轨迹分析:模型分析历史任务失败模式

脚手架优化:自主调整采样参数(temperature、frequency penalty等)

工作流迭代:设计更具体的执行指南(如修复后自动搜索同类bug)

循环检测增强:为Agent循环添加防重复机制

在内部测试中,M2.7通过100+轮自主迭代优化,在编程任务上实现了30%的性能提升。

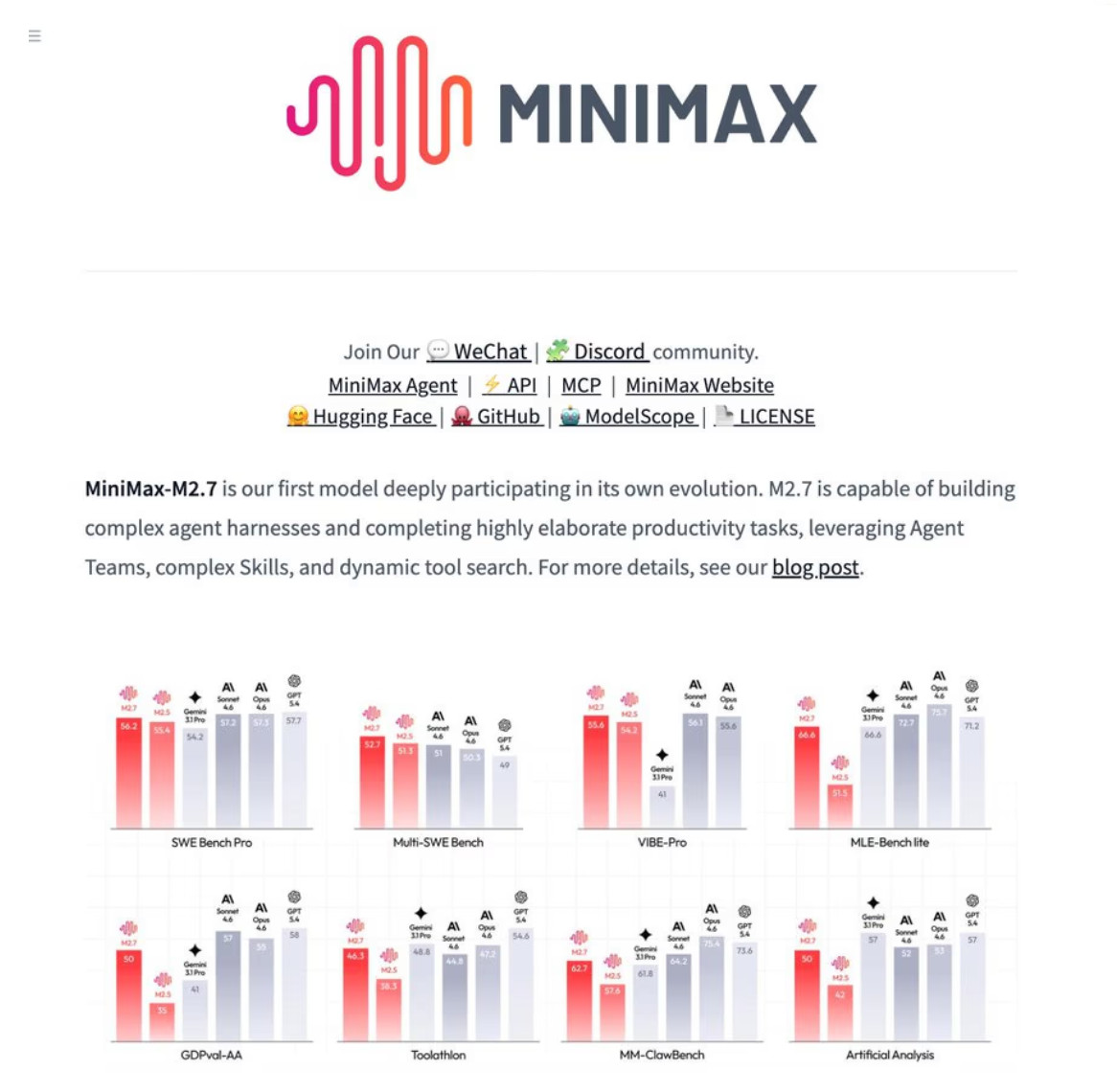

关键性能指标

| 基准测试 | MiniMax M2.7 | Claude Opus 4.6 | GPT-5.3-Codex | 测试维度 |

|---|---|---|---|---|

| SWE-Bench Verified | 78% | 80.84% | — | 真实GitHub问题解决 |

| SWE-Pro | 56.22% | ~57% | 56.2% | 多步Agent工作流 |

| SWE Multilingual | 76.5 | — | — | 非Python代码能力 |

| Terminal Bench 2 | 57.0% | — | — | 复杂工程系统理解 |

| VIBE-Pro | 55.6% | — | — | 端到端项目交付 |

| GDPval-AA (ELO) | 1495 | — | — | 办公生产力(开源模型第一) |

| 相对吞吐量 | ~3x | 1x(基准) | — | 推理速度 |

数据来源:MiniMax官方技术文档及NVIDIA NIM模型卡

生产级能力:从代码生成到系统运维

真实场景:生产故障3分钟恢复

传统编程模型擅长生成代码片段,但M2.7的设计目标是完整的软件工程生命周期:

故障排查工作流示例:

关联监控指标与部署时间线进行因果推理

统计分析链路采样数据,提出精准假设

主动连接数据库验证根因

定位代码仓库中缺失的索引迁移文件

执行止血操作:使用非阻塞索引创建阻止故障扩大

提交合并请求完成修复

MiniMax内部数据显示,该流程多次将生产事故恢复时间压缩至3分钟以内。

多语言与复杂系统理解

不同于多数模型在Python外的性能衰减,M2.7在SWE Multilingual基准上取得76.5分,对TypeScript、Go、Rust、Java等语言保持稳定的代码理解与生成能力。

在NL2Repo(39.8%)和Multi SWE Bench(52.7%)等需要仓库级理解的测试中,M2.7展现出对软件系统运行逻辑和协作动态的深层认知。

开源部署:三种接入方式详解

方式一:Hugging Face本地部署

硬件要求与量化方案:

| 量化级别 | 所需显存 | 推荐GPU | 推理速度 | 性能保持 |

|---|---|---|---|---|

| FP8 | 80GB | A100 | ~100 tokens/s | 100%(基准) |

| Q8 | 48GB | A6000 | ~85 tokens/s | ~97.7% |

| Q4 | 24GB | RTX 4090 | ~70 tokens/s | ~88.2% |

建议:生产环境至少使用Q8量化以维持性能

部署步骤:

从Hugging Face下载模型权重:

MiniMaxAI/MiniMax-M2.7选择推理框架(推荐SGLang或vLLM)

配置推理参数:

temperature=1.0,top_p=0.95,top_k=40启动服务并验证工具调用能力

方式二:API云服务接入

定价结构(与M2.5保持一致):

输入:2.1元/百万token(约$0.30)

输出:8.4元/百万token(约$1.20)

接入渠道:

MiniMax官方平台:https://platform.minimax.io/

NVIDIA NIM端点:build.nvidia.com

方式三:Agent平台集成

MiniMax提供完整的Agent开发环境,支持:

Agent Teams:原生多智能体协作

复杂Skills:40+项复杂技能,每项超2000 token,技能遵循率达97%

动态工具搜索:根据任务需求自动检索工具

开发者决策框架:何时选择M2.7

适用场景

| 场景特征 | 推荐理由 | 替代方案 |

|---|---|---|

| 高并发Ticket处理 | 3倍于Opus的吞吐量,成本仅为1/17 | — |

| 多语言代码库(TS/Go/Rust/Java) | SWE Multilingual 76.5分,跨语言性能稳定 | Claude Opus 4.6(Python为主) |

| 端到端项目交付 | VIBE-Pro 55.6%,支持Web/Android/iOS全栈 | — |

| 自托管隐私要求 | Apache 2.0开源协议,数据完全本地 | — |

| Agent工作流原型验证 | 低试错成本,支持复杂技能编排 | — |

慎用场景

多模态需求:M2.7仅支持文本,图像/OCR需切换至Qwen3-VL

极限SWE-Bench需求:若需绝对最高的单点 benchmark分数,Opus 4.6仍有3%优势

纯数学推理:DeepSeek R1在AIME等数学基准上表现更优

结语:开源编程Agent的新基准

MiniMax M2.7的开源标志着高效能编程Agent进入"10B参数时代"。它证明:通过架构创新(MoE)与训练范式革新(自我进化),中等规模模型完全可以在特定领域挑战旗舰闭源模型。

对于开发者而言,这意味着成本结构的可控性——同样的预算可完成10倍于以往的任务量;对于企业而言,这意味着部署灵活性的提升——自托管不再意味着性能妥协。

模型权重现已可在Hugging Face获取,API服务同步上线。建议从非关键业务场景开始验证,逐步建立基于M2.7的Agent工作流。

MiniMax M2.7登Hugging Face:78% SWE-Bench验证率