痛点直击:做短视频配乐,找不到合适的BGM;想改编经典老歌送给家人,却不懂编曲;AI生成的音乐总是"塑料感"十足,听起来像机器人念经——这些困扰创作者多年的问题,如今有了新解法。

2026年4月10日,MiniMax正式发布新一代音乐生成模型Music 2.6。这次升级并非简单的参数提升,而是从底层引擎到创作工具的全维度重构:首包延迟压至20秒以内,新增Cover翻唱功能支持旋律提取与风格迁移,人声刻意引入气音等"瑕疵"以提升真实感。目前该模型已向全球创作者开放14天免费内测。

一、Cover翻唱功能:上传音频即可提取旋律,实现跨风格改编

1.1 功能原理与核心价值

Cover功能是Music 2.6最具突破性的新增能力。用户上传一段参考音频(支持6秒至6分钟时长,最大50MB),模型会精准提取其旋律骨架,随后创作者可自由修改骨架之外的所有元素——风格可以从民谣跳到重金属,编曲可以从古典交响转成赛博朋克电子,也可以保留旋律完全替换歌词。

这解决了一个此前AI音乐生成无法完成的任务类型:不是"生成一首新歌",而是"把一首已有的歌变成另一种样子"。官方示例中,《友谊地久天长》被转换为完全不同风格的版本,旋律可辨认但整体听感焕然不同。

1.2 典型应用场景

| 场景类型 | 具体操作 | 产出价值 |

|---|---|---|

| 短视频二创 | 上传热门歌曲Hook片段,改写歌词结合热点话题 | 降低翻唱制作成本,快速追热点 |

| 情感礼物定制 | 将长辈喜爱的老歌改编为子女演唱风格 | 半小时完成过去需要编曲团队的工作 |

| 游戏配乐 | 同一旋律生成City Pop(日常场景)与EDM(Boss战)双版本 | 实现游戏情绪的动态切换 |

| 个人Demo开发 | 人声哼唱旋律上传,生成多风格编曲版本 | 零乐理基础完成专业级Demo |

1.3 版权风险提示

需要特别注意的是,基于已有音乐旋律的再创作涉及版权边界问题。MiniMax目前未公开说明版权处理机制,创作者在商业场景下使用需自行确认原曲授权情况。

二、20秒极速响应:告别"开盲盒"式漫长等待

2.1 技术架构重构带来的速度跃升

Music 2.6对底层生成架构进行了深度重构,首包延迟大幅降至20秒以内。这意味着创作者输入文字灵感后,只需一次深呼吸的时间就能收到初步音频反馈,告别以往AI音乐生成中动辄数分钟的漫长等待。

速度提升并非以牺牲质量为代价。模型在加速的同时,同步强化了以下控制能力:

BPM与调性锁定:创作者设定的节拍速度和调式将被忠实还原,不再偏离

段落结构控制:对主歌、副歌及过渡段的理解力显著增强,支持[Intro]、[Verse]、[Chorus]等14种结构标签

情绪弧线执行:人声和乐器音色的情绪表达更加精准,创作意图不再被稀释

2.2 使用流程(三步完成创作)

访问并登录:进入MiniMax Audio官网(minimaxi.com/audio/music),完成账号登录。当前处于14天免费内测期,C端用户每日可享500首免费创作额度

输入创作参数:

在"风格"框输入描述(限2000字符),如"130 BPM的电子舞曲,忧郁氛围"

在"歌词"框粘贴歌词(限3500字符),或使用

/查看结构标签如需Cover模式,切换模型至"music-cover"并上传参考音频

生成与精修:点击生成后约20秒内获得初稿,可在线预览并迭代调整,确认后下载256kbps MP3格式成品

三、"气音瑕疵"设计:AI人声从"机械精准"走向"真实松弛"

3.1 审美取向的关键转变

过往AI人声的最大短板是"机械感过重"——发音过于规整、情绪过于平淡,缺乏人类演唱时的松弛感与感染力。Music 2.6在人声处理上做出了重要调整:刻意褪去"机械般精准"的工业化唱腔,转而呈现出更具随性与自由感的真实演唱状态。

这种"不完美"的设计体现在:

气声处理:保留演唱中的自然呼吸声与气口停顿

语气起伏:段落之间加入更符合人类习惯的抑扬顿挫

情绪张力:情感爆发时的动态范围更接近真人演唱

3.2 国风与氛围音乐的针对性优化

在国风音乐场景中,模型特别优化了二胡揉弦、笛子气口、古筝扫弦、戏腔收放等此前AI难以处理的细节。更关键的是乐器之间的时序演进——开场留白、弦乐和弹拨逐层进入、旋律与人声最后推到顶点——这种层次感是此前"国风音色包机械拼接"的生成方式无法实现的。

在lo-fi、indie folk、独立爵士等风格中,这种刻意的不精准转化为律动的呼吸感,适合咖啡馆、氛围空间等需要"好听但不抢戏"的场景。正如一位咖啡馆主理人的实测反馈:"播放时没人会被打扰,但偶尔会有顾客停下来问'这是谁在唱?'"

四、中低频声学优化:解决AI音乐"低音松散"顽疾

Music 2.6针对创作者长期诟病的"低频松散、律动不足"问题进行了系统性优化。贝斯和鼓点在下潜深度与咬合紧密度上均有提升,在House、Trap、Drum & Bass等重低音风格中表现尤为明显。

这一改进直接受益的场景包括:

游戏Boss战配乐:低频推动情绪的能力显著增强,独立游戏开发者可用一个下午完成整套配乐,成本从外包数千元降至零

车载与耳机场景:在低音耳机、车载音响中,鼓点与贝斯不再糊成一片,能够真正推动视觉画面

五、Music Skill开源:让AI Agent学会创作音乐

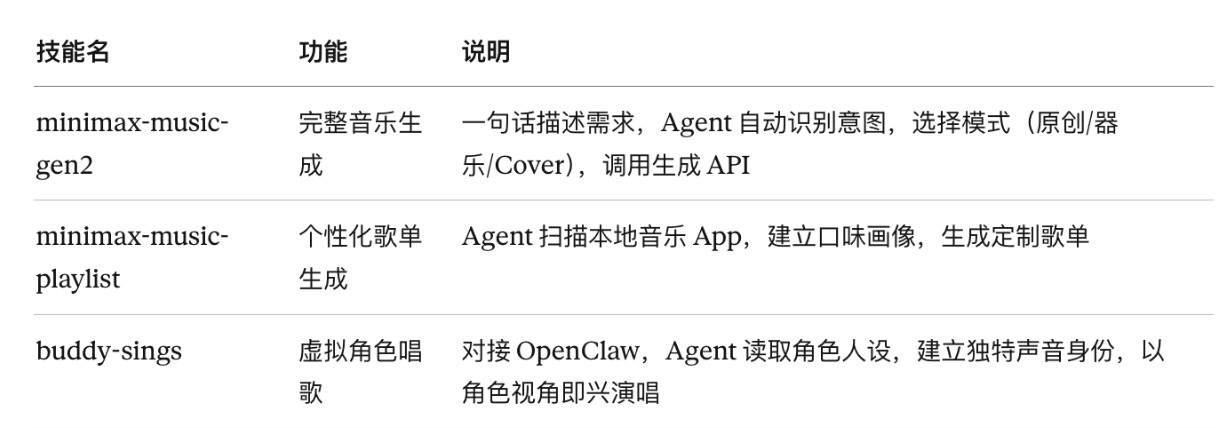

MiniMax同步开源了3个面向AI Agent生态的Music Skill,标志着音乐生成能力正从独立工具演变为Agent可调用的模块化能力:

| Skill名称 | 核心功能 | 适用对象 |

|---|---|---|

| minimax-music-gen | Agent自动识别意图,选择原创/纯音乐/Cover模式并调用API | Agent开发者 |

| minimax-music-playlist | 扫描用户本地音乐应用(Apple Music、QQ音乐等),构建品味画像并生成定制歌单 | 音乐平台/个人用户 |

| buddy-sings | 联动OpenClaw,读取角色人格构建声音身份,以第一人称即兴创作演唱 | 虚拟伴侣/游戏NPC开发者 |

开发者可通过GitHub获取这些Skill,结合Claude Code、OpenClaw等Agent框架,让AI助手具备原生音乐创作能力。

结语:从"随机生成"到"有意创作"

MiniMax Music 2.6的发布,标志着AI音乐进入"可控创作"新阶段。Cover功能让旋律改编成为可能,20秒延迟让实时创作成为现实,气音瑕疵让AI人声获得人情味——这些改进共同指向一个核心目标:降低创作门槛,同时提升产出质量的可预期性。

目前14天免费内测正在进行中(截至2026年4月24日),普通用户每日500次生成额度,开发者额外获赠100次API调用。对于短视频创作者、独立音乐人、游戏开发者乃至普通音乐爱好者而言,这是一个值得亲自验证的窗口期。

技术永远是工具。当工具足够易用,它所真正解放的,是那些始终怀有想法、却苦于缺乏表达途径的人。

参考链接: